Chat GPT исполнилось три года, какие итоги? Это не риторический вопрос — за эти годы модель успела встряхнуть целые индустрии, изменить способы работы и общения и породить массу споров о будущем труда и этики. В этой статье я прошагаю по ключевым вехам, оценю реальные эффекты и дам практические рекомендации тем, кто хочет использовать технологии осмысленно.

- От старта до массового признания: как все происходило

- Технологические достижения: что поменялось под капотом

- Ключевые улучшения по направлениям

- Сравнительная таблица версий (упрощённо)

- Влияние на бизнес: процессы, продукты, экономика

- Типичные кейсы применения

- Образование, наука и творчество: новые возможности и риски

- Этика, право и общество: что тревожит и что уже решено

- Главные риски

- Экономические эффекты: кто выиграл, кто адаптируется

- Безопасность и надёжность: что сделано и что нужно улучшить

- Технические меры

- Чему научились разработчики и компании за три года

- Прогнозы на ближайшие годы: чего ждать

- Краткие прогнозы

- Практические советы: как использовать ChatGPT эффективно сегодня

- Советы для бизнеса и индивидуальных пользователей

- Мой опыт работы с моделью: что я заметил как автор

- Что нужно знать перед массовым внедрением

- FAQ

- 1. Как улучшились возможности ChatGPT за три года?

- 2. Насколько безопасно полагаться на ответы модели?

- 3. Какие профессии больше всего изменились из‑за ChatGPT?

- 4. Что делать компаниям, которые хотят внедрить технологию?

- 5. Чего ждать в ближайшие годы?

От старта до массового признания: как все происходило

Первые версии чат-моделей казались экспериментом — полезным, но с очевидными ограничениями. За три года развитие ускорилось: улучшилась сложность диалогов, выросла точность ответов, появились дополнительные возможности вроде интеграций и плагинов.

Рост популярности сопровождался не только техническим прогрессом, но и активным обсуждением в СМИ, в бизнес-среде и среди регуляторов. Момент, когда инструмент стал не просто демонстрацией, а рабочим ресурсом для миллионов, наступил быстро.

Технологические достижения: что поменялось под капотом

За три года архитектуры и данные тренировок эволюционировали — модели стали лучше понимать контекст, держать длинные диалоги и работать с разными форматами информации. Появились механизмы более гибкого дообучения и интерфейсы для подключаемых сервисов.

Немаловажно, что улучшилось управление безопасностью и фильтрация нежелательного контента, хотя проблемы с «галлюцинациями» всё ещё остаются предметом внимания исследователей.

Ключевые улучшения по направлениям

С точки зрения пользователя заметны три вещи: ответы стали релевантнее, взаимодействие — удобнее, а интеграция с внешними сервисами — глубже. Для разработчиков важна открытая экосистема API и возможность тонкой настройки под задачи бизнеса.

Сравнительная таблица версий (упрощённо)

| Параметр | Ранние модели | Современные версии |

|---|---|---|

| Понимание контекста | Короткие контексты, частые ошибки | Длинный контекст, устойчивый переход тем |

| Качество генерации | Иногда бессвязные фрагменты | Более связные и релевантные ответы |

| Инструментальность | Ограниченные интеграции | Плагины, API, вспомогательные сервисы |

| Механизмы безопасности | Примитивные фильтры | Сложные фильтры, RLHF, мониторинг |

Влияние на бизнес: процессы, продукты, экономика

Компании начали использовать чат-ориентированные модели в службах поддержки, маркетинге, аналитике и автоматизации рутинных задач. Это снизило нагрузку на сотрудников и ускорило время реакции. При этом выгода зависит от качества интеграции и понимания ограничений технологии.

Новые инструменты породили целые продуктовые ниши: от сервисов автогенерации контента до ассистентов для программистов и юридических помощников. Появились специализированные стартапы, которые берут на себя адаптацию моделей под конкретную отрасль.

Типичные кейсы применения

- Автоматизация горячих линий и клиентской поддержки.

- Генерация маркетинговых материалов и A/B-копий.

- Помощь разработчикам: автодополнение, поиск по коду, генерация тестов.

- Аналитика документов и вытаскивание сущностей.

- Поддержка принятия решений: сводки новостей и краткие обзоры.

Образование, наука и творчество: новые возможности и риски

В сфере образования модели стали инструментом для объяснения сложных вещей простым языком, для помощи при подготовке домашних заданий и для генерации материалов преподавателей. Это открыло доступ к персонализированному обучению, но одновременно поставило вопрос честности оценивания и академической этики.

В науке ChatGPT помогал в подготовке обзоров литературы, формулировке гипотез и проверке логики рассуждений. Однако автоматическая генерация не заменяет экспертную проверку — особенно когда речь идет о воспроизводимости и корректности фактов.

Творческие профессии получили мощный инструмент для брейншторминга: сценарии, стихи, музыкальные идеи стали рождаться быстрее. Я лично использовал модель как «сопроцессор» при подготовке статей — это заметно ускоряло черновую работу, но финальную правку всегда приходилось делать вручную.

Этика, право и общество: что тревожит и что уже решено

Среди главных вопросов — честность выводов модели, авторские права и распространение дезинформации. Общество задаёт тон дискуссии: нужно ли маркировать тексты, созданные ИИ, и как защищать интеллектуальную собственность?

Регуляторы в ряде стран начали вводить требования по объяснимости и безопасности. Компании, в свою очередь, внедряют внутренние политики использования и инструменты мониторинга. Это движение к регулированию пока скорее набирает обороты, чем завершилось.

Главные риски

- Галлюцинации — вымышленные факты или ссылки, которые выглядят достоверно.

- Автоматическое воспроизводство приватных или защищённых данных.

- Использование для мошенничества и социальной инженерии.

- Несправедливые решения в автоматизированных системах (bias).

Экономические эффекты: кто выиграл, кто адаптируется

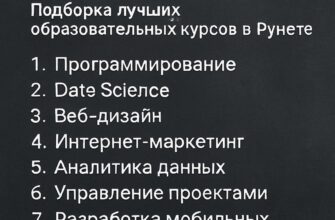

Часть профессий трансформируется — рутинную работу автоматизируют, а человеческий вклад смещается в область контроля качества, креатива и этики. Появилась потребность в «переподготовке» сотрудников для работы рядом с ИИ.

Стартапы в экосистеме получили доступ к мощным инструментам без больших затрат на инфраструктуру, что ускорило инновации. При этом крупные платформы удерживают значительную часть прибыли за счёт инфраструктуры, данных и маркетинга.

Безопасность и надёжность: что сделано и что нужно улучшить

Модели начинают «учиться» от обратной связи: внедряются механизмы обучения с подкреплением от человеческой оценки, системы обнаружения вредоносного использования и возможности отката. Это повышает надёжность, но не делает её абсолютной.

Важно понимать, что полная безопасность — недостижимая цель; задача инженеров и регуляторов — снизить вероятность серьёзных инцидентов до приемлемого уровня и создать механизмы восстановления после ошибок.

Технические меры

- Фильтры контента и динамическая блокировка запросов.

- Модели-метрики для оценки правдивости ответов.

- Прозрачность в использовании данных и контроль доступа.

Чему научились разработчики и компании за три года

Практика показала: успех зависит не только от модели, но и от внедрения. Грамотное проектирование интерфейса, логика проверки фактов и учёт человеческого фактора важнее, чем попытки «заточить» модель под все задачи.

Ещё одно наблюдение: участники рынка, которые инвестировали в обучение сотрудников и в процессы контроля качества, получили долговременное преимущество. Быстрое прототипирование плюс строгий контроль — рабочая формула.

Прогнозы на ближайшие годы: чего ждать

Технология будет интегрироваться глубже: ИИ окажется в инструментах для разработки, в системах управления предприятиями и в бытовых устройствах. Мы увидим рост ассистентов, способных не только отвечать, но и действовать через подключённые сервисы.

Параллельно будет развиваться регулирование, а общество выработает новые нормы взаимодействия с ИИ: что допустимо, а что — нет. Это приведёт к более зрелым коммерческим практикам и ясности в вопросах ответственности.

Краткие прогнозы

- Улучшение качества фактических ответов за счёт гибридных систем (ИИ + базы данных).

- Рост специализированных моделей для конкретных отраслей.

- Расширение экосистемы плагинов и безопасных интеграций.

- Усиление правовой базы и стандартов прозрачности.

- Появление новых профессий, связанных с верификацией и настройкой ИИ.

Практические советы: как использовать ChatGPT эффективно сегодня

Если вы собираетесь внедрять технологии в работу, начните с малого: выберите одно узкое решение, измерьте эффект и масштабируйте. Хорошая проверка — если автоматизация экономит время и не ухудшает качество, проект стоит развивать дальше.

Ниже — несколько конкретных правил, которые сэкономят вам время и нервы.

Советы для бизнеса и индивидуальных пользователей

- Чётко формулируйте задачу и ожидаемый результат перед генерацией.

- Включайте этапы валидации — ручную или автоматическую — для критичных ответов.

- Храните логи взаимодействий для анализа и обучения моделей.

- Не заменяйте эксперта полностью: используйте ИИ как ассистента, а не судью.

- Интегрируйте проверки фактов при работе с данными и источниками.

Мой опыт работы с моделью: что я заметил как автор

Я применяю такие модели для быстрой генерации идей и структурирования статей. Впечатляет скорость, с которой рождается черновик, но каждая итоговая публикация требует приложения авторского опыта: факты проверяются, стиль выверяется, идеи углубляются.

Иногда ИИ помогает увидеть неожиданные ракурсы темы — это похоже на разговор с коллегой, который знает много, но не всегда верно делает ссылки. Такой союз творит чудеса, если за ним стоит критическое мышление.

Когда я впервые дал модели сложный запрос по технической теме, ответ был содержателен, но в одном месте содержал устаревший факт. Это напомнило мне важность проверки и того, что доверять без оглядки пока нельзя.

Что нужно знать перед массовым внедрением

Организациям важно подготовить сотрудников: процессы должны учитывать новые роли и задачи. Технически — обеспечить безопасность данных и соответствие требованиям закона. И ещё — внедрение требует культуры тестирования и итераций.

Помните: успех измеряется не количеством автоматизированных сценариев, а тем, насколько система улучшила ключевые метрики: скорость, точность и удовлетворённость клиентов.

Три года — это только начало. Мы уже видим, какие возможности открываются, и одновременно понимаем, что многие аспекты ещё требуют работы. Технология перестала быть научной демонстрацией; она стала повседневным инструментом. Важно использовать её разумно и ответственно.

FAQ

1. Как улучшились возможности ChatGPT за три года?

Качество понимания контекста значительно выросло, модели стали лучше держать длинный диалог, снизилось количество очевидных ошибок. Появились интеграции, плагины и инструменты для гибкой настройки под задачи бизнеса.

2. Насколько безопасно полагаться на ответы модели?

Модель полезна для поиска идей и первичной обработки информации, но не заменяет проверку фактов. Для критичных решений рекомендуется дополнять ответы верификацией из авторитетных источников или использовать гибридные решения с контролем достоверности.

3. Какие профессии больше всего изменились из‑за ChatGPT?

Сильнее всего трансформировались роли, связанные с рутинной обработкой текста: техподдержка, копирайтинг, часть аналитики и подготовка отчетов. Появились новые профессии: разработчики систем с ИИ, специалисты по контролю качества и верификаторы контента.

4. Что делать компаниям, которые хотят внедрить технологию?

Начать с пилота: определить узкую бизнес‑задачу, внедрить прототип, оценить эффект и только затем масштабировать. Особое внимание уделить безопасности данных, обучению сотрудников и процессам проверки результатов.

5. Чего ждать в ближайшие годы?

Улучшения качества ответов, рост специализированных моделей, расширение интеграций с сервисами и появление новых регуляторных норм. Технология станет глубже интегрированной в рабочие и бытовые процессы.

Если вам интересны подробные обзоры и практические кейсы по технологиям, заходите на сайт https://dailydevices.ru/ и читайте другие материалы на нашем ресурсе.